The Black Eyed Peas Experience

イニス Interview 「超短期間でのダンスゲーム開発を可能にしたHumanIK等の新ミドルウェア活用術」

- 3ds Max

- MotionBuilder

- ゲーム

「The Black Eyed Peas Experience」は、グラミー賞6度受賞に輝く人気ヒップホップグループ「The Black Eyed Peas(以下「BEP」)」をフィーチャーした最新ダンスゲーム。北米・ヨーロッパのみの発売だが、にも関わらず日本のヒップホップファンやダンスゲームファンの注目を集めている。もちろんファッションや音声、しぐさから全28曲に及ぶ人気ナンバーに合わせて作り込まれた印象的なダンスの数々まで、リアルに再現されたBEPの魅力が注目されるのは当然だが、そこにダンスゲームとしての新しさや楽しさがなければ、ダンスゲームファンに支持されるのは難しかっただろう。実はこのゲームにおける最大のポイントは、Kinectによるアバターを用いたユニークで没入感の高いゲームシステムやグラフィックなど、ダンスゲームとしての新しさとクオリティの高さにある。イニスの小澤明訓氏ら開発スタッフの皆様にお話を伺った。

新しいデバイス「Kinect」を生かした新しい遊びを

――まずゲーム自体の概要をご紹介ください

小澤氏:このゲームは世界的な人気を持つヒップホップグループ The Black Eyed Peasを全面にフィーチャーしたダンスゲームです。ユーザはゲーム内に自作したアバターを操り、総計28曲のBEPナンバーそれぞれのダンスパフォーマンスをBEPメンバーから学び、また勝負しながら、2×4ステージをステップアップしていきます。ゲームには、少しずつダンスムーブを学びながら成長していけるこのキャリアモードの他に、初めから全ての曲で自由に遊べるパーティモードがあり、ユーザは好きな方を選んでプレイできます。

――ゲームの1番の特徴はやはりBEPをフィーチャーしている点でしょうか

小澤氏:そうですね。何と言ってもBEPありきのゲームですから、彼らの魅力を100%引きだし伝えながら、同時にダンスゲームを楽しんでもらうことに一番力を入れています。開発期間に割ける時間があまりなく、厳しいスケジュールでの開発となりましたが、BEPのメンバーたちも非常に協力的で、忙しい時間の合間を縫って彼らから実際に音声やモーションをキャプチャーさせてもらうチャンスも与えられましたし、振り付けの作成にはBEPの公式振付師であるFatima Robinson氏も参加してくれました。さらにはゲーム本体の完成時にはいち早くBEPメンバーの自宅にゲームを持ち込んだところ、その仕上りに大いに喜んだメンバーが、twitterで本作の素晴らしさを紹介するなどいろいろ宣伝してくれました。彼らは特に、グラフィックの美しさや全体のリアリティが凄いと驚いてくれたそうです。

株式会社イニス

ゼネラルマネジャー

小澤 明訓 氏

――そして、もう一つのポイントがKinectですね

アイエル氏:ええ。Kinectを用いた"アバターシステム"という仕組みが、本作のダンスゲームとしてのもう一つの売りです。アバターシステムとは、簡単に言えば Kinectでユーザのダンスステップのモーションをゲーム内に取り込んで、これをゲーム内にユーザ自身がカスタマイズしたアバターへリアルタイムに反映させ、ゲーム内でキャラクタとユーザのアバターを共演させることができるというシステム。憧れのBEPとユーザ自身のアバターでダンスで共演できるのですから、ゲームへの没入感は一段と大きくなるでしょう。また、ダンスゲームではステップ修得が一つの壁になりがちですが、本作ではどのダンスも総計9つのステップで構成されており、これを3ステップずつ小分けし、分かりやすいガイドに従って遊びながら進めていくことができます、だから誰でも自然に踊れるようになるんですよ。

3Dアニメーションマネジャー

ウィルフリッド アイエル 氏

――開発期間がたいへん短かったと聞きましたが?

小澤氏:実はこのゲームは、もともと2009年頃に"Kinectという新しいデバイスを使った新しい遊び"を考えようと始まったプロジェクトが基となっています。当社は音楽ゲームを作ってきた会社ですし、その時はすぐにKinectを生かしたダンスゲームというアイデアが生まれました。もっとも当初はBEPを単独でフィーチャーする発想はなく、複数のアーチストのさまざまな曲で遊べるダンスゲームという企画だったんです。ともかくそんな形で企画を詰め、開発に取りかかりました。開発を進める中でユービーアイソフトさんと一緒にやろうということになり、同社の「Experience」シリーズの1本としてBEPをフィーチャーすると決まったのが3~4月頃。そしてマスターアップが9月ですから、開発期間は実質半年ということになります。これはパブリッシャーの意向で、ホリディシーズンまで開発を完了して発売することが条件となっていたからです。Kinectを使ったダンスゲームとしてのコア部分はある程度できていましたが、それでもこれほどのボリューム、クオリティのゲームなら、開発は最低でも1年半、できれば2年ほしいところです。しかしこのような大前提があったので、この9月のマスターアップは遅れることは許されません。絶対に守るしかない〆切だったんです。「ではどうするか」という話になり「どうやって対応するか」すごく考え、使えるものは全部使って結果なんとかできた、というわけです。ある意味怖いなという気もしますね(笑)。

――開発に関して一番のポイントとなったのは?

小澤氏:Experienceシリーズの1本として、BEPという本物のアーチストをフィーチャーするわけですから、まずこのBEPの魅力を存分に引きだして、これをユーザにきちんと伝えつつ、楽しくダンスゲームを遊んでもらえるようにしなければなりません。キャラクタモデリングはもちろん、背景もアニメーションもユーザーインターフェイスも楽曲もダンスも、ゲームのあらゆる面に渡って、BEP本人たちの持ち味を生かすような作りにしようと考えました。そして、同時にもう一つの大きな課題となったのが生産性の向上です。前述の通り、通常よりはるかに短い開発期間で、しかも高いクオリティを実現していくにはどうするか。このことに関して徹底的に追求していきました。

超短期間の開発を可能にしたミドルウェアの活用

――高品質と生産性の両立にミドルウェアの活用が重要だったそうですが?

小澤氏:その通りです。今回の開発に際して、私たちは3ds MaxやMotionBuilderをメインツールとして使用しましたが、こうした定番ツール以外にも、Autodesk HumanIKやAutodesk Scaleformといったミドルウェアを導入、活用して大きな成果を挙げることができました。特にHumanIKについては、本作の大きな" 売り"であるアバターシステムに関わる非常に重要な課題解決に貢献してくれました。正直いってHumanIKの活用がなければ、アバターシステムを現在のような形で実装することは難しかったかもしれません。本当に助けてもらったな、という実感があります。

――HumanIKの活用内容についてご紹介ください

アイエル氏:前述の通り、アバターシステムでは、画面の前で踊るユーザの動作をKinectで拾い、その動きをゲーム内のアバターにリアルタイムで転送していく仕組みが基本となっています。しかし、実際にこれをやってみるとKinect自体の機能に限界があって、ユーザのダンスの動作を高い精度で認識させることが難しかったのです。

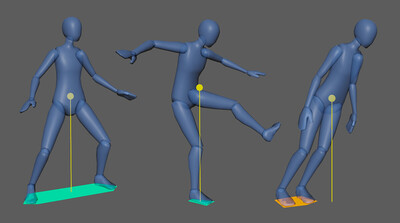

小澤氏:特に全身の動きを拾おうとすると、いわゆる"足が滑る"状態になり、モーション全体が汚く見えてしまうんですね。しかし、アバターシステムを売りにしている以上、なんとかしてユーザの動作をアバターに反映させたい。そこで、何とかならないか試行錯誤を繰り返していたんですが、なかなか思うような成果が上がらず、最終的には半ば妥協して全身の動きを拾うことを断念しました。下半身の動きを拾うのは難しいので、これはもう割り切って、上半身の主に腕の動きを中心に拾う決断をしたんです。この上半身と手の動きでアバターとのシンクロ感を演出し、後はダンスのモーション自体をきれいにしていくことに注力しようというわけですね。

――その方法で、上手くいったのでしょうか?

アイエル氏:それでも問題は残りました。上半身の腕の動きを拾っていくにもKinectでは限界があって、Kinectからのデータを反映させようとすると、アバターの腕の関節等がありえない角度や方向に曲ってしまったりするんです。これはどうしても、人間の動きとして不自然でない範囲に収めなければなりません。われわれはゲームエンジンとしてUnreal Engineを使っていたので、当初このUnreal上で何とかできないかいろいろ試しました。かなりの所まで追い込んだんですが、どうしても見栄えの悪さを脱することができず、この方向でのチャレンジを断念。代わりに使える仕組みをいろいろ当たっていくうちに出会ったのがHumanIKでした。このHumanIKを使ってリミット制御システムを試みると、これが非常に良い成果が出たのですぐに採用しました。

――なぜHumanIKが選ばれたのでしょうか?

小澤氏:HumanIKは、私たちが今回使ったUnreal Engineとの親和性が高く、統合されていてすぐに使えるようになった点が非常に大きかったです。他のソフトの場合、インテグレートされていても最適化されておらず、厳しいスケジュール下では使い難い場合も多いのです。でも、HumanIKはきちんと最適化されていたので導入は非常にスムーズで、しかも当社としてはMotionBuilderとほぼ同じ設定で使えるのも魅力的でした。MotionBuilderに長けた人間ならすぐ使えますからね。とはいえ、採用が決まったのは本当にギリギリで、7月頭頃。そこから大急ぎで調整し、実際にアバターシステムに入れて形になったのが8月。そしてマスターが9月ですから、わずか1ヶ月前です。実は先方からは「見た目が汚いままならシステムごとカットしてくれ」と言われるほど追いつめられていたんですよ。繰り返しになりますが、本当に助けられました。

――もう一つのミドルウェアであるScaleformについてはいかがですか?

藤田氏:Scaleformに関しては、メニューまわりでの利用が中心となります。というか、本作では基本的にテキストが出てくるような部分は、ほぼ全でScaleformを使って作っていますが、凄く使いやすくて気に入っています。特にFlashでアセットを組んで、そこでプレビュー等もできてしまうので、このオーサリングを知っているスタッフに教えて使ってもらえれば、その作業を完全に分離できる点が素晴らしい。スクリプトを書く側とアセットを作る側に完全に分けられるので、生産性の向上という点でも大きな力を発揮しました。

――本作もメニューが非常に作り込まれてますね

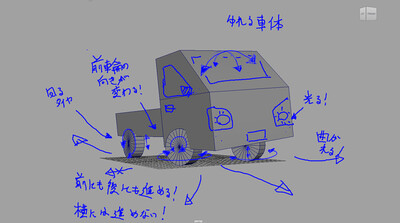

藤田氏:もともと当社はメニューまわりへのこだわりが強い会社で、今回もメニューに関してかなり凝った作りをしています。単純に2Dでメニュー類を出す程度なら簡単ですが、たとえば3D空間上に2Dのメニューを配置し、さらにそのテクスチャ上に字も出すといった複雑なパターンが多々あるんです。しかし、Scaleform内部の機能を調べるうちに、こうした処理も簡単にできると分かり、後半はスムーズに作れるようになりました。一番苦労したのは、ゲーム画面上端でユーザのダンスの次のステップをガイドする小さな白い人体アイコンですね。これは一見2Dに見えますが3Dとしてダンスをさせているので非常に難しく、かなり複雑な処理を施しています。また、カラオケ機能の歌詞の色の変化の演出も凝っています。上手く歌うと歌詞の色の塗られ方が変わっていくんですが、この演出はFlashだけでは上手く表現できず苦労しました。ここでは、Scaleformの2D描画にUnreal Engineのマテリアル機能を合わせて処理しています。

ディレクター

藤田 尚俊 氏

――Scaleformの導入経緯をご紹介ください

藤田氏:Unreal Engineは2D部分の作成が不得意だったので、以前から対策としてミドルウェアの調査を進めていました。これがScaleform導入のきっかけです。特に本作ではメニューに関して多彩な要求があったので、ここまでいろいろやろうとするとUnreal Engineの標準的な機能だけでは実装が難しい。そこでScaleformを採用しました。使いこなせるようになるまで多少時間はかかりましたが、前述の通り習得後はかなりスピードアップし、導入前に作った部分を後からどんどん修正していって何とか間に合わせました。

- 1

- 2